A Microsoft intimidou Phi-4-Flash-Flash-Razão, leve para Scyuurios com imagens de memória ou liberação. Designável para dispositivos de borda e aplicativos móveis, os aplicativos móveis, o modelo AIIMS para delinear fortes razões para o raciocínio do hardware de numeração.

PHI-4-FLASH-ROASE para Packs 3,8 bilhões de parâmetros e billids nas instruções da família PHI-4 em dezembro, com o foco da razão matematal.

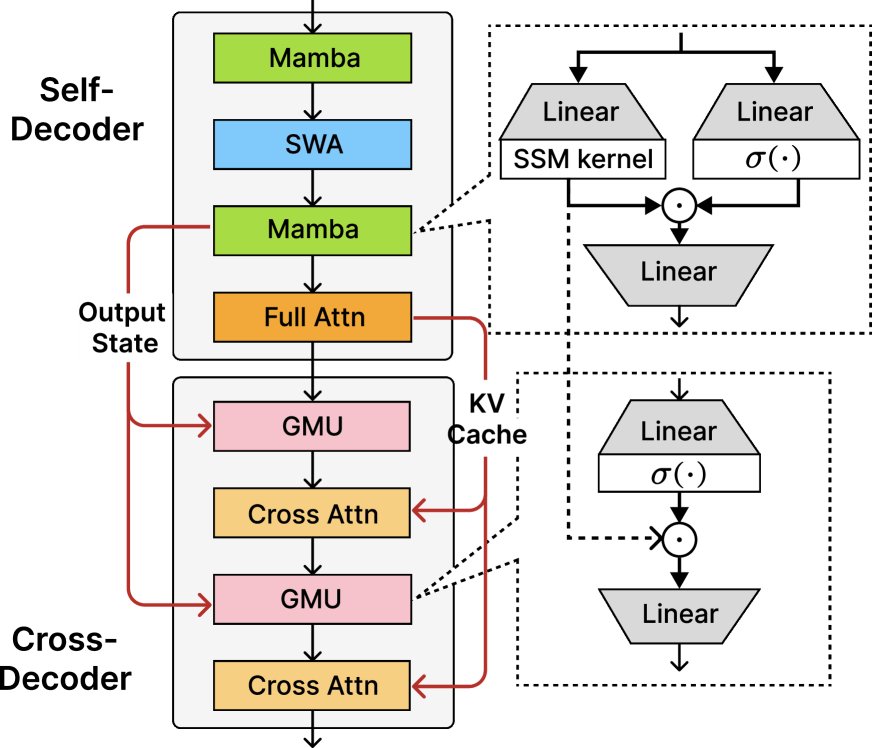

No centro do novo modelo, há uma artesecture atualizada chamada Sameting A (GMM) unidades de memória fechada (GMM) e “atenção diferente”. Transformadores tradicionais Representam a atenção complexa em Evier Laser para decidir quais partes dos topos de entrada.

O GMMA simplifica isso substituindo as operações de atimento cruzado pesadas entradas turzen e o estado de memória da camada Anyzier. Isso permite que o modelo recalibre dinamicamente, que Tomens se concentrar no Winust Everhead.

Anúncio

O boletim do decodificador

A notícia mais importante para sua caixa de entrada.

✓ Semanalmente

✓ Free

✓ Cancelar no horário

Compartilhar

Recomendar nosso artigo

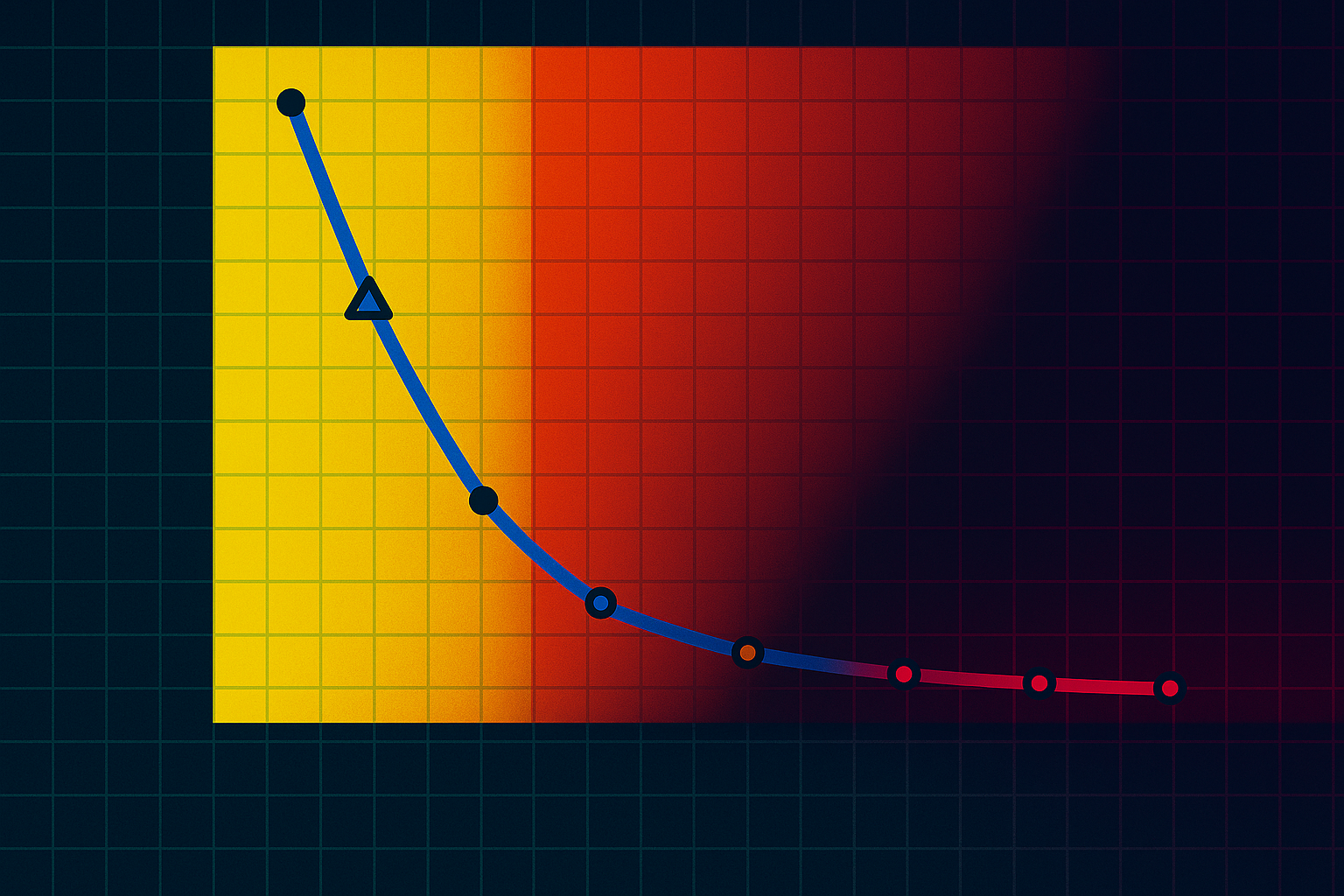

Sayay mistura mecanismos de atenção Sevall: uma única camada de atenção completa cria, enquanto o cache da GMUs, permitindo que as camadas compartilhem informações por meio de multiplicações de informações. Essa abordagem lenta o uso da memória e os requisitos de computação. Em modelos típicos, os transferências de dados entre entre memória e processador sobem como fundamentos do comprimento da sequência, mas Damy, isso Ramys é principalmente plano.

Nova Articletture por mais eficien Reason

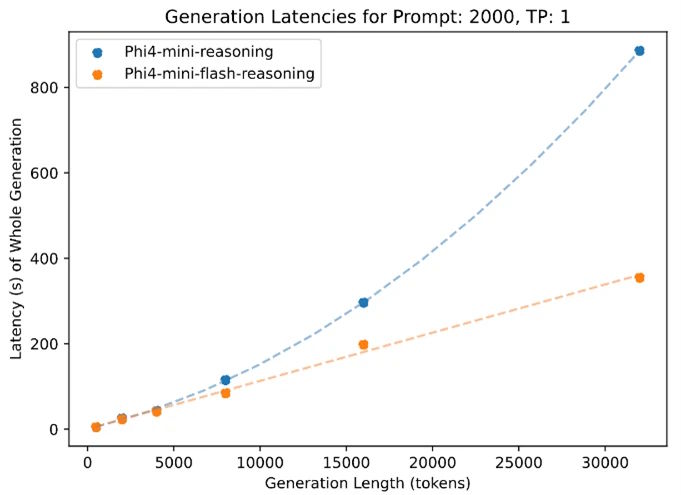

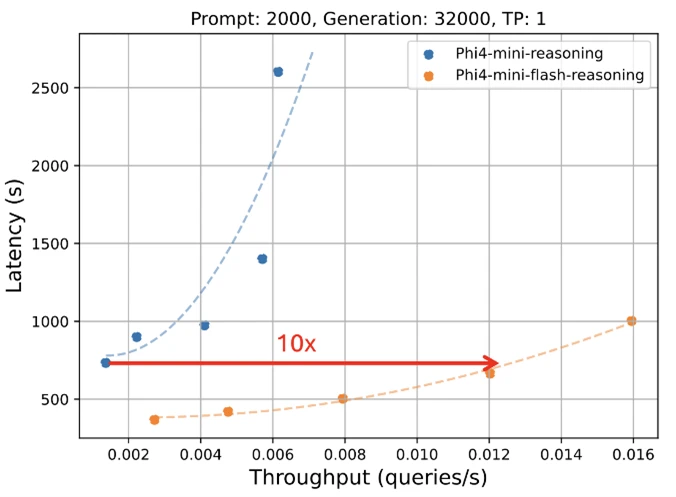

TE TE ARTSCTING CHANGELES BING OF SIGNIFACOLUTIVO Bost no desempenho. A Microsoft diz que o Phi-4-Flash-REASONS entrega até o TS Times Highthy por um fator de dois para Thyced em seu prepararssor. No entanto, os resultados do Tuke são baseados em testes com GPUs industriais, não nos dispositivos de baixo resistência à qual o modelo é destinado.

Phi-4-Flash-Reasons também se destaca em lidar com contatos longos. O modelo suporta a janela de contexto de até 64.000 tokens e pode reduzir sua velocidade e desempenho, mesmo com capacidade máxima. A Microsoft cita o design do Efray, que continua processando as SPESForms – um excesso de aventuras claras.

Superando modelos maiores em referência de raciocínio

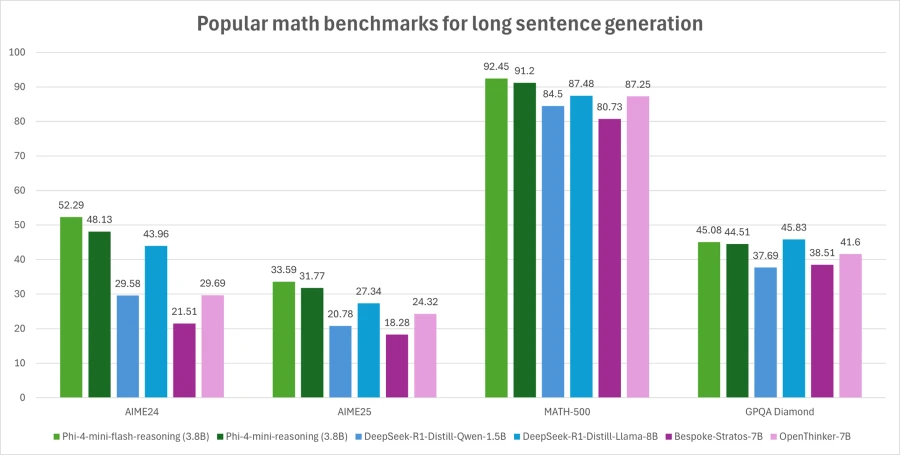

A versão flash sola em benchmarks. PHI-4-FLASH-FLASH-ROUSE está treinando em cinco trilhões de tyens.

Nos testes, ele venceu consistentemente o modelo de bases, especialmente sobre o conhecimento interenizado e programando tintas de porcentagem de ganhaeal de Gaineal. O modelo acena melhor no motivo de matemática e cientificação, todos os Witant a etapa de aprendizado de reforço pesada de recursos usada em versões anteriores.

Phi-4-mini-flash-Ralon está disponível em Abraçando o rostoe a Microsoft reivindicava exemplos de código no Livro de receitas Phi. A base de código de treinamento completa é de origem aberta Giwub.

Postagens relacionadas

Deixe um comentário Cancelar resposta

Você precisa fazer o login para publicar um comentário.

Fique conectado