O novo sistema de IA chamado StreamDit CantE Live Moves das descrições de texto, abrindo a atualização da nova posisabilidade para jogos e mídia interativa.

Desenvolvido por pesquisadores da Meta e da Universidade da Califórnia, Berkeley, Streamdit cria vídeos em um momento real de um único GPO de ponta. O modelo, com 4 bilhões de parâmetros, produz vídeos na resolução de 512p. Ultima métodos anteriores que os videoclipes completos de genestate abordam os transmissões de vídeo ao vivo, quadro da FARA.

Vídeo: Kodaira et al.

A equipe exibiu vários casos de uso. Vídeos de StreamDit Canté de um minuto em tempo real, respondam a instruções intelectivas e edite os vídeos existentes em tempo real. Em uma demonstração, o porco em um vídeo foi transformado em Cat Whit, os planos da mesma forma.

Anúncio

O boletim do decodificador

A notícia mais importante para sua caixa de entrada.

✓ Semanalmente

✓ Free

✓ Cancelar no horário

Compartilhar

Recomendar nosso artigo

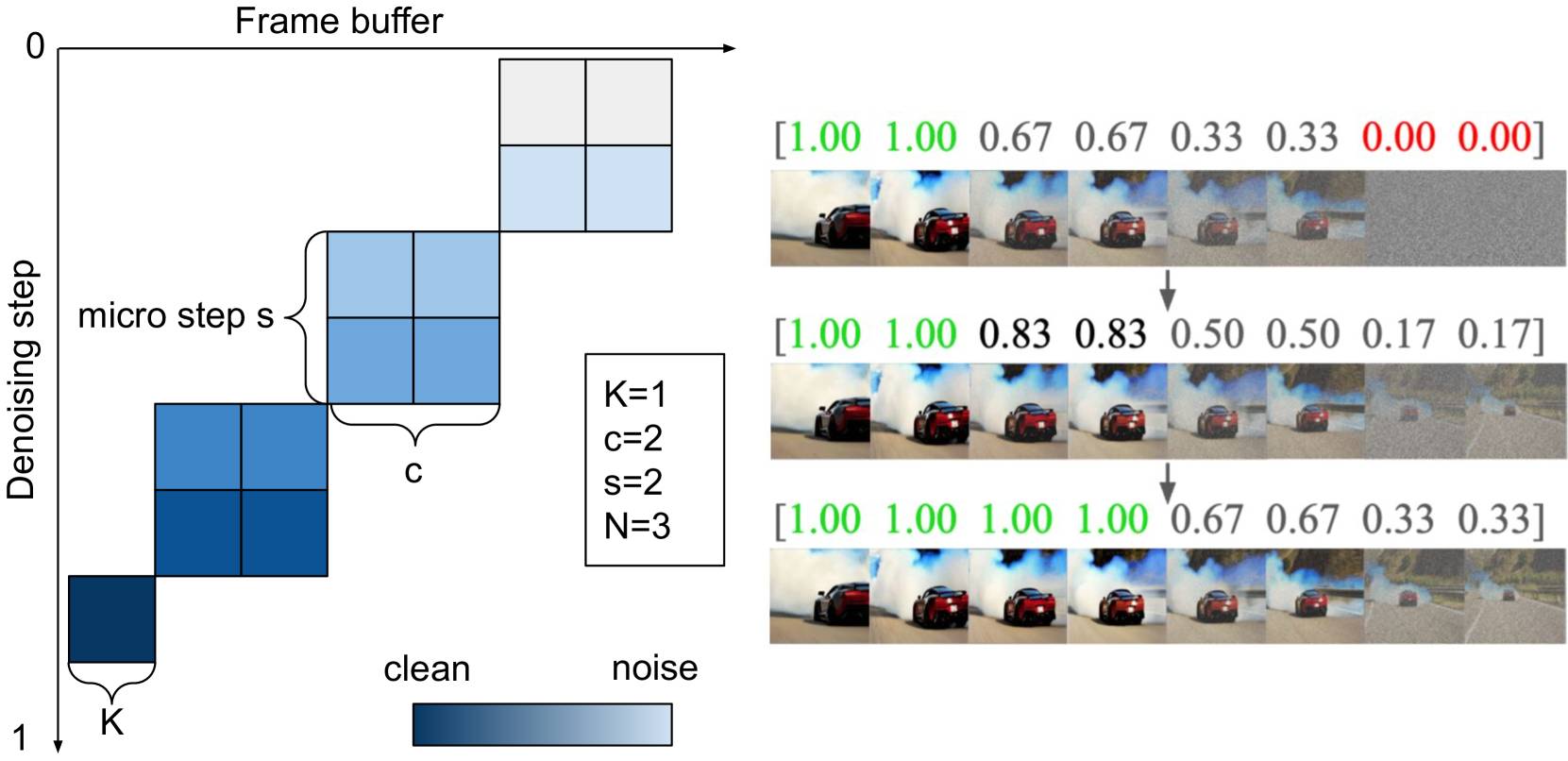

O sistema depende da SATURE ARTSTER Custom construída para velocidade. Usos de streamdit de buffer de movimento para processar quadros de vários biles simples, trabalhando na necessidade de Fara sedutor. Novos quadros começam barulhentos, mas são graduados em reviva tatil os são lidos para exibição. De acordo com o artigo, o sistema tributou cerca de meio segundo Farans, produz oito com o IGESESESEDESED IGESED.

Treinamento para versatilidade

O processo de treinamento foi projetado para melhorar a versatilidade. Em vez de se concentrar no método de criação de foda, o modelo estava treinando ritmos resumidos, usando 3.000 vídeos Highty e Laarger Datat de 2,6 milhões de vídeos. O treinamento ocorreu em 128 GPUs NVIDIA H100. Os pesquisadores descobriram que a mistura de tamanhos de bloco de 1 a 16 quadros produz os melhores resultados.

Para a execução em tempo real em tempo real, a equipe da equipe, a equipe informável e o Access Ted corta o número de etapas de cálculo requerem, para apenas 8, com um impacto mínimo na qualidade da imagem. A arkacture também é otimizada para eficiência: rathsanimant evey imenements, as informações são trocas apenas entre a reabilitação local.

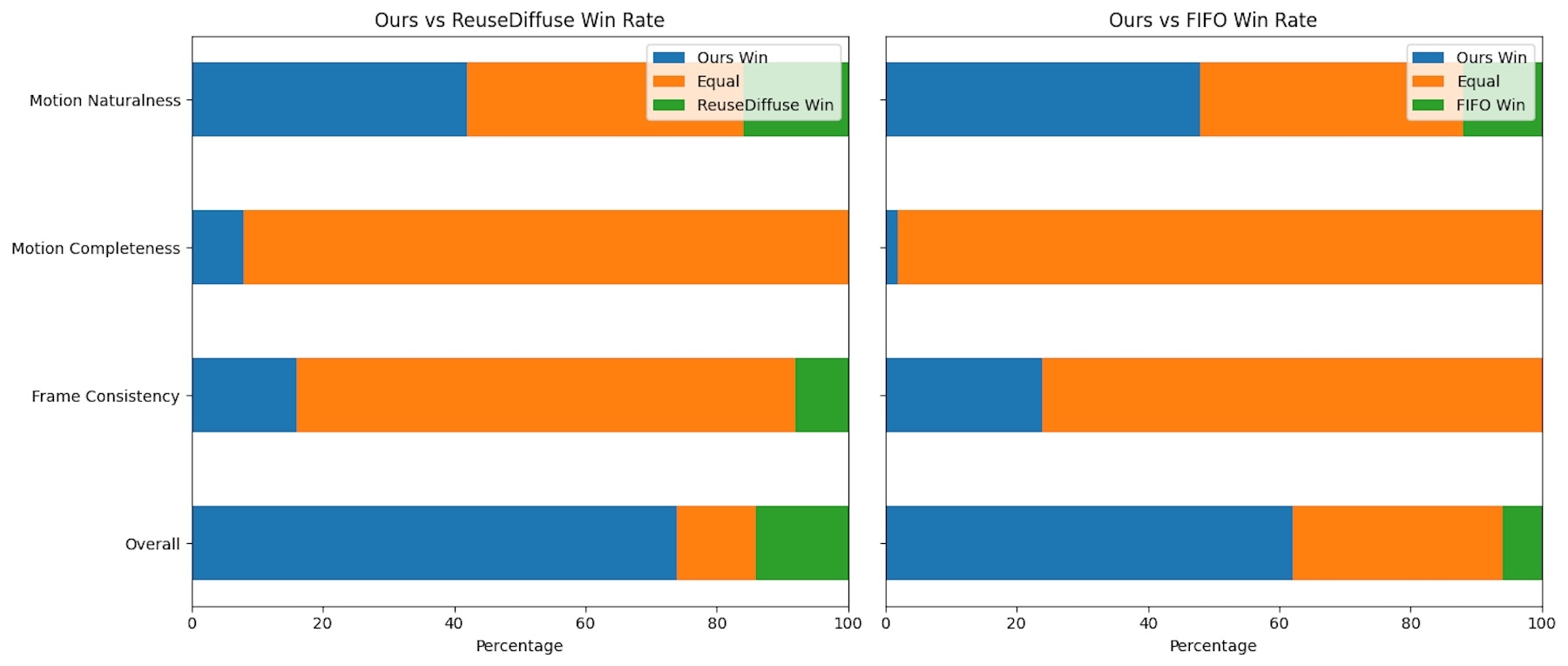

Nas comparações frente a frente, o StreamDit superou os métodos existentes como Reusediffuse e FIFO Diffusion, especialmente para vídeos com muito movimento. Os outros modelos tendiam a criar para criar cenas estáticas, o StreamDit Games mais dinâmico e o movimento natural.

As taxas humanas recalaram a execução do sistema no syformace A fluidez do movimento, a integridade dos quadros de animulação e a qualidade geral. Em todas as categorias, o StreamDit ficou no topo do melhor de Ben em vídeos de oito segundos e 512p.

Modelo maior, melhor qualidade, mas mais lento

A equipe também experimenta a maior qualidade de vídeo de modelo de 30 bilhões de 30 bilhões, insitando o seu reino. Os sinais de resultados assinam a abordagem pode escalar para sistemas maiores.

Vídeo: Kodaira et al.

Algumas imitações remortam, incluindo a abidade limitita do StreamDit para as partes anteriores do “Relmember” do vídeo e o ocasiamal visível traduções entre proteções entre proteções entre as seções. Os pesquisadores dizem que estão trabalhando em soluções.

Outras empresas Aare também exploram a geração de vídeo da IA em tempo real. O Odyssey, para uma apagamento, recentemente intrava um modelo de vídeo modelo de modelo AutoReReReReGresting World em Restern, Mingart Intective Experience, Experiências MakTives mais acessos.

Postagens relacionadas

Deixe um comentário Cancelar resposta

Você precisa fazer o login para publicar um comentário.

Fique conectado